Arquivos duplicados? fdupes neles!

Veremos aqui como recuperar espaço em disco utilizando a ferramenta fdupes, que trata da remoção dos arquivos duplicados.

Introdução

E mais uma vez tive problemas com meus arquivos pessoais. Bem, não são meus, mas é como se fossem, já que recai sobre mim a tarefa de recuperá-los.

Quando fiz o artigo sobre o PhotoRec aqui no VOL, tive um problema parecido, dessa vez não sei se o real problema foi a criação das unidades virtuais pelo Wine e como o sistema as trata, ou se é um 'bug' do PcManFM no que tange aos links simbólicos.

O fato é que ao mover meus arquivos de backup da minha "/home" do Debian (para o backup uso o 'rsync'), é de praxe que, ao restaurá-los para a nova "/home", uso o tradicional 'Ctrl+C' e 'Ctrl+V', daí que veio o problema: ao clicar em cancelar (na janela de progresso) simplesmente todos os dados das pastas pessoais de minha esposa e filha, foram deletados.

Lembro que na pasta 'Desktop' havia 2 links simbólicos para as referidas pastas, que tem sua localização real em "/media/arquivos".

Enfim, voltei ao fantástico Photorec. Se você não conhece, eis o link:

Tendo recuperado os arquivos, na verdade os de extrema importância, eram as fotos e documentos ".doc".

Obs.: As extensões a serem ignoradas e uma solução mais elegante (cortesia do colega hudyfx) podem ser vistas neste tópico do VOL:

Embora excelente, o único problema do Photorec é que os arquivos recuperados não ficam com os nomes originais, e muitas das vezes mais de uma versão do mesmo arquivo é recuperada.

É para este segundo caso que trataremos agora. Com vocês o fdupes!

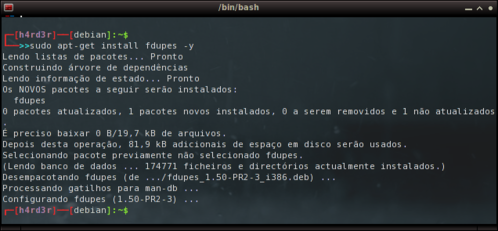

Disponível para a maioria das distribuições, instalá-lo no Debian e em seus derivados é muito simples:

sudo apt-get update

$ sudo apt-get install fdupes -y

O 'help' do programa:

fdupes --help

Quando fiz o artigo sobre o PhotoRec aqui no VOL, tive um problema parecido, dessa vez não sei se o real problema foi a criação das unidades virtuais pelo Wine e como o sistema as trata, ou se é um 'bug' do PcManFM no que tange aos links simbólicos.

O fato é que ao mover meus arquivos de backup da minha "/home" do Debian (para o backup uso o 'rsync'), é de praxe que, ao restaurá-los para a nova "/home", uso o tradicional 'Ctrl+C' e 'Ctrl+V', daí que veio o problema: ao clicar em cancelar (na janela de progresso) simplesmente todos os dados das pastas pessoais de minha esposa e filha, foram deletados.

Lembro que na pasta 'Desktop' havia 2 links simbólicos para as referidas pastas, que tem sua localização real em "/media/arquivos".

Enfim, voltei ao fantástico Photorec. Se você não conhece, eis o link:

Tendo recuperado os arquivos, na verdade os de extrema importância, eram as fotos e documentos ".doc".

Obs.: As extensões a serem ignoradas e uma solução mais elegante (cortesia do colega hudyfx) podem ser vistas neste tópico do VOL:

Embora excelente, o único problema do Photorec é que os arquivos recuperados não ficam com os nomes originais, e muitas das vezes mais de uma versão do mesmo arquivo é recuperada.

É para este segundo caso que trataremos agora. Com vocês o fdupes!

Disponível para a maioria das distribuições, instalá-lo no Debian e em seus derivados é muito simples:

sudo apt-get update

$ sudo apt-get install fdupes -y

O 'help' do programa:

fdupes --help

Ótima ferramenta, não conhecia esta.

Valeu cara.

Abraço.